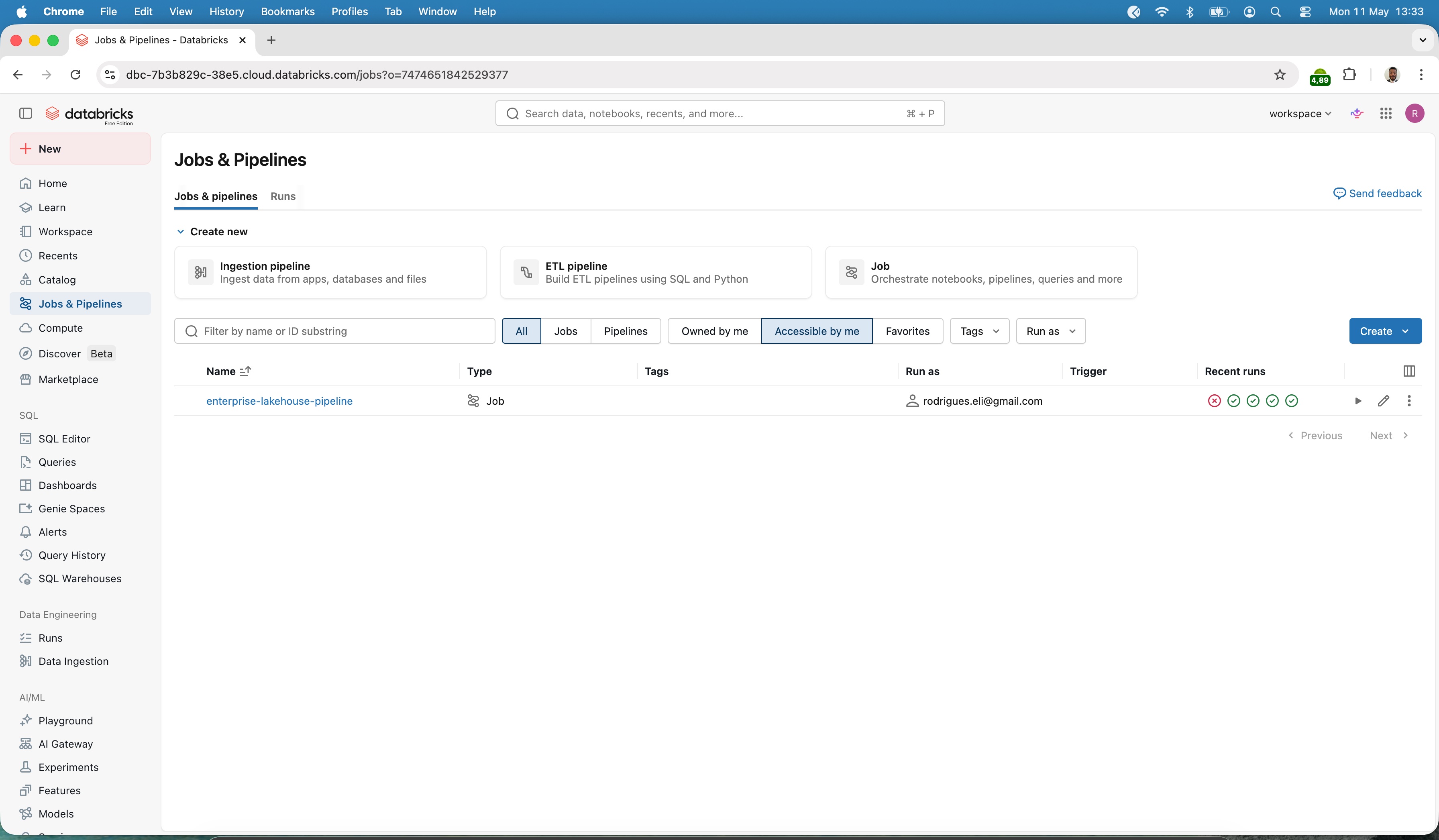

Pipeline enterprise com DAG operacional no Databricks

Execução ponta a ponta das camadas Bronze → Silver → Gold com Data Quality Validation, troubleshooting operacional e observabilidade centralizada via Databricks Jobs.

Projeto desenvolvido com foco em práticas de engenharia de dados corporativa, incluindo orquestração serverless, observabilidade operacional, governança de pipelines, data quality validation e troubleshooting operacional em arquitetura Lakehouse.